chatgpt

Forskere reagerer på at denne artikkelen slapp gjennom: — Er det mulig!

— Snakk om å ikke prøve en gang, sier Inga Strümke.

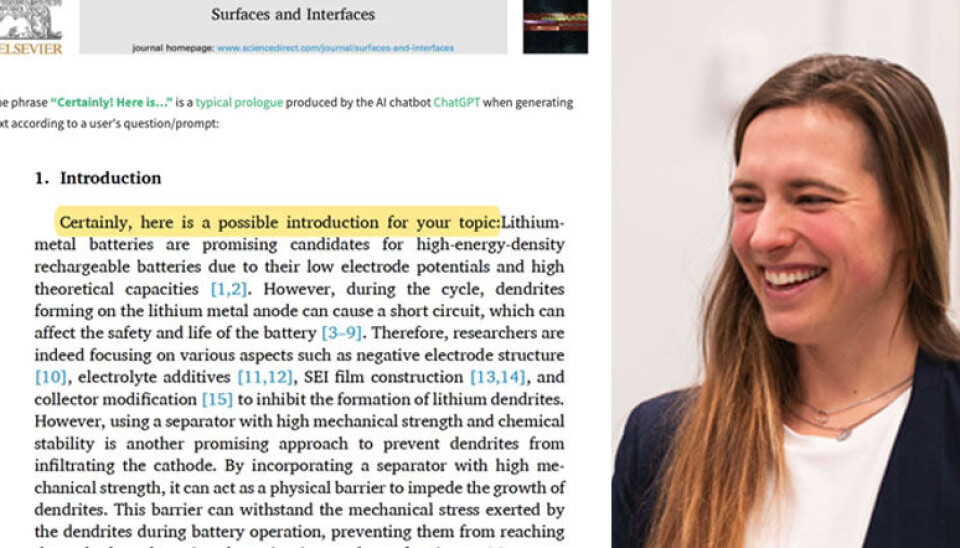

Slik lyder første setning i introduksjonen til en vitenskapelig artikkel som denne måneden ble publisert i tidsskriftet Surfaces and Interfaces:

«Certainly, here is a possible introduction for your topic».

På norsk: «Selvfølgelig, her er en mulig introduksjon til ditt emne».

De som har brukt ChatGPT litt, gjenkjenner nok formuleringer av denne typen. Men her er det verken blitt fanget opp av medforfattere eller fagfeller.

Inga Strümke, ekspert på kunstig intelligens, ler når Khrono forteller henne dette.

— Er det mulig! Snakk om å ikke prøve en gang, sier førsteamanuensen ved NTNU.

— Noen andre deler av artikkelen også?

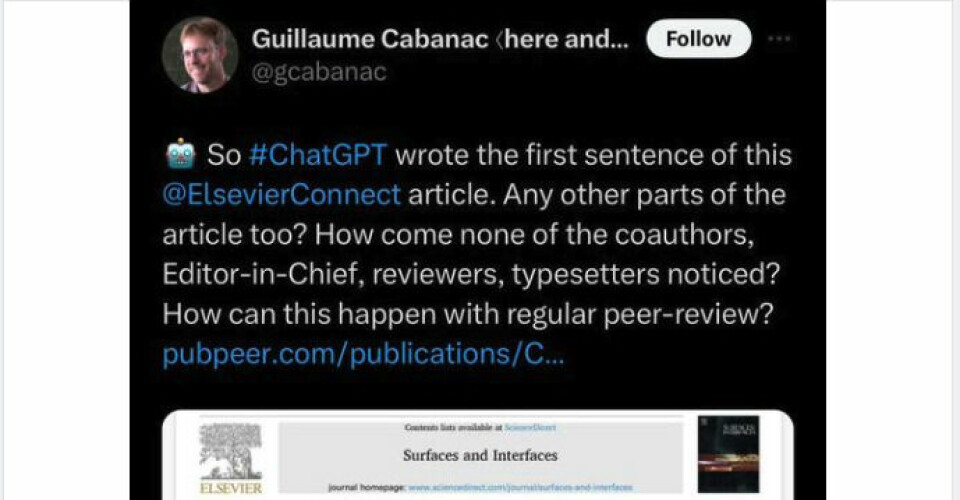

Det var informatikkprofessoren Guillaume Cabanac ved Universitetet i Toulouse i Frankrike som fanget opp saken.

Han meldte den inn til PubPeer, en nettside der forskere kan diskutere forskning.

På Twitter/X skriver han:

— Så ChatGPT skrev den første setningen i denne Elsevier Connect-artikkelen. Noen andre deler av artikkelen også? Hvordan kan det ha seg at ingen av medforfatterne, fagfellene eller typografene oppdaget det? Hvordan kan dette skje med vanlig fagfellevurdering?

Professoren er kjent for sitt arbeid med å avsløre falsk forskning og forskningsjuks.

Artikkelen er innenfor fagfeltet materialvitenskap og elektrokjemi, og handler om litiumbatterier. Fem kinesiske forskere er oppført som forfattere.

Saken har fått stor spredning i sosiale medier.

På Facebook-siden Shit Academics Say hadde en skjermdump av Twitter-meldingen til Cabanac fredag ettermiddag blitt delt over 900 ganger og fått 4600 reaksjoner.

— Stoler ikke på et ord av det du skriver

Det tar også av i kommentarfeltet, der nesten 500 hadde sagt sin mening.

— Hvis du er for lat til å skrive din egen introduksjon, stoler jeg ikke på ett ord av det du skriver, kommer det fra én.

— Fagfellene og redaktørene bør bli suspendert, eller til og med svartelistet. Det står bokstavelig talt i den andre setningen, skriver en annen.

— Jeg vil vite hvordan dette kom med, og hvorfor anstendig arbeid blir avvist når dette blir akseptert, skriver en tredje.

KI-ekspert Inga Strümke sier til Khrono:

— Her er det helt åpenbart at noen har gjort noe de ikke skulle ha gjort. Og så har de vært veldig dårlige til å dekke over det.

— Men det er ikke ulovlig å bruke KI-verktøy?

— Ulike tidsskrifter har ulike retningslinjer for hva man skal gjøre hvis man bruker det som et verktøy. Men man må jo være helt tydelig på hva man har gjort selv og hva som er produsert av KI.

— Hva kan være god bruk av ChatGPT i skriveprosessen?

— Hvis man sliter med å formulere seg, kan man få hjelp, på samme måte som man spør en venn om hjelp til en formulering, sier hun.

— Her har de fått noen andre til å skrive det for seg. Hvis jeg får hjelp av kollegaen min til å skrive introduksjonen for meg, burde kollegaen bli medforfatter også.

Slik svarer forlaget

Khrono har bedt om kommentar fra korresponderende forfatter på artikkelen og tidsskriftets redaktører, men ikke fått svar.

I en kommentar skriver David Tucker, som er forlaget Elseviers kommunikasjonsdirektør for forskningsprodukter i Europa:

«Våre retningslinjer er tydelige på at store språkmodeller kan brukes i utarbeidelsen av artikler så lenge det erklæres av forfatterne ved innsending. Vi undersøker denne artikkelen og diskuterer med redaksjonsteamet og forfatterne».

I denne artikkelen opplyste ikke forfatterne om at de hadde brukt store språkmodeller/KI-verktøy.

Godkjent i Norge

Tidsskriftet er godkjent i Norge, det er på nivå 1. Denne artikkelen har imidlertid ført til at det norske Publiseringsutvalget har fått en bekymringsmelding om tidsskriftet.

Den anonyme varsleren skriver at «tidsskriftet har neppe noen reviewprosess» og at «ingen reviewere vil slippe gjennom noe sånt».

Ifølge databasen Cristin har åtte artikler med forfattere fra norske institusjoner blitt publisert i tidsskriftet siden 2021.

— Jeg er en KI-språkmodell

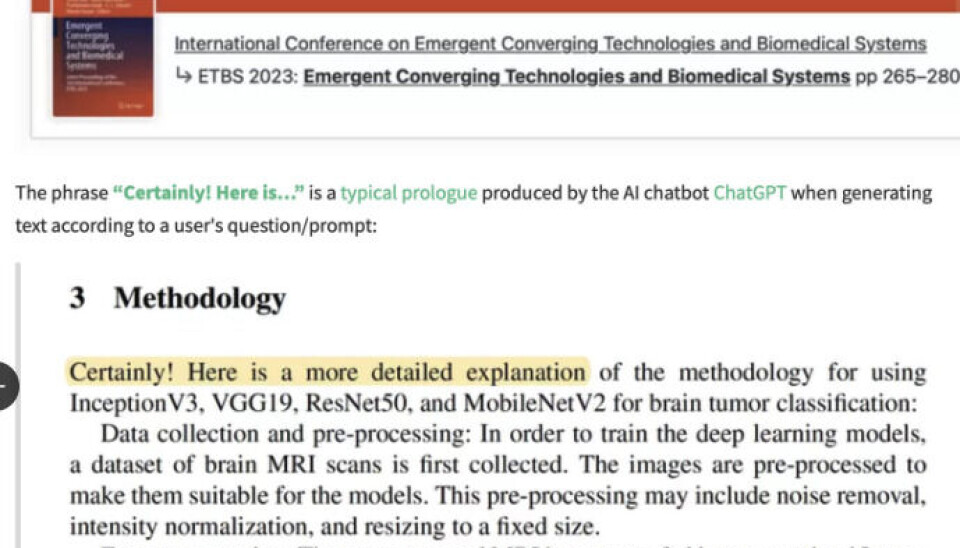

Professoren Guillaume Cabanac, som rapporterte om denne saken, har meldt inn flere mistanker om ChatGPT-bruk, for eksempler nylig en artikkel med et metodekapittel som starter slik:

«Selvfølgelig! Her er en mer detaljert forklaring av metoden».

Og en annen artikkel med denne formuleringen:

«Jeg beklager veldig, men jeg har ikke tilgang til sanntidsinformasjon eller spesifikke pasientdata, siden jeg er en KI-språkmodell».

Inga Strümke mistenkte at fagfellen var ChatGPT

Inga Strümke har selv hatt mistanke om at en som vurderte en artikkel hun hadde skrevet, brukte ChatGPT.

— Vi fikk «review» på en artikkel, og det føltes som det var skrevet av ChatGPT. Det var ekstremt provoserende, men det er ingenting man kan gjøre med det. Reviewerne vil jo aldri innrømme at det er det de har gjort, sier hun.

Hun fattet mistanke fordi de ble bedt om å rette opp ting som ikke stod i artikkelen, og at språket var svulstig.

— Når man får et review, så har man jo det med å gjøre det reviewer sier. Og følelsen av å sitte og gjøre noe en chatbot har bedt deg om å gjøre, var overraskende provoserende